12 月 2 日消息,英伟达周一宣布推出新的基础设施与人工智能模型,旨在构建“具身智能”(Physical AI)的核心技术基础,包括能够感知并与现实世界互动的机器人和自动驾驶车辆。

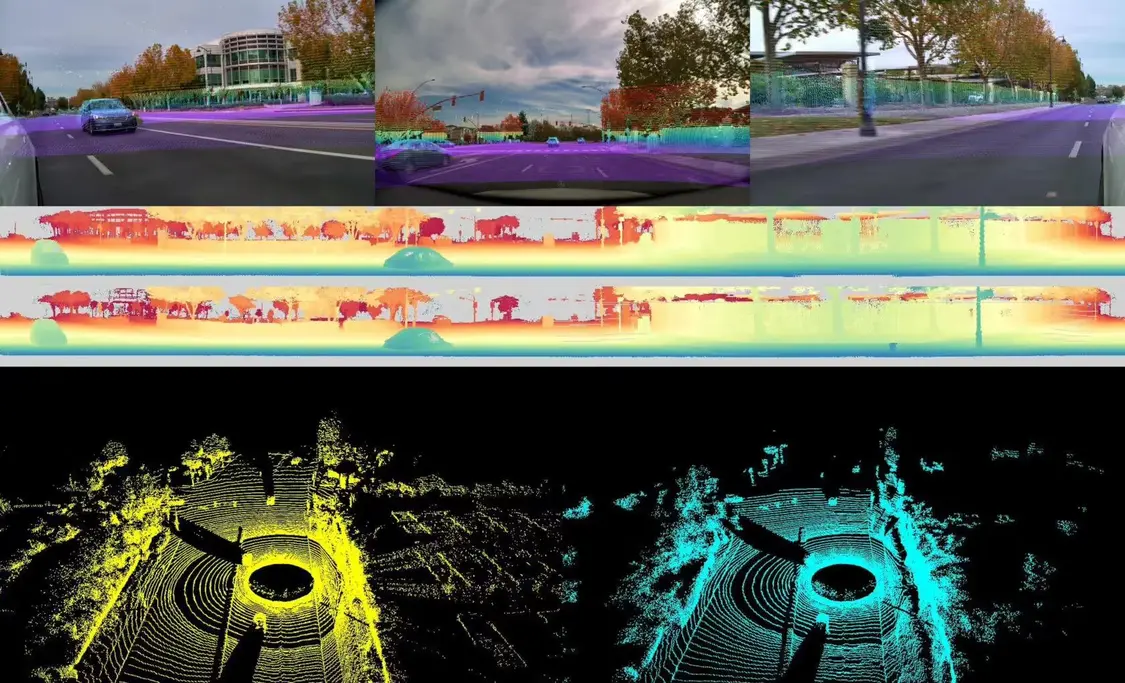

这家半导体巨头在加利福尼亚州圣地亚哥举行的 NeurIPS 人工智能大会上发布了 Alpamayo-R1—— 一款面向自动驾驶研究的开源推理型视觉语言模型。该公司称,这是业界首个专注于自动驾驶领域的视觉语言动作模型。视觉语言模型能够同时处理文本与图像信息,使车辆能够“看见”周围环境,并基于所感知的内容做出决策。

该新模型基于英伟达此前推出的 Cosmos-Reason 推理模型构建,后者具备在响应前对决策进行逻辑推演的能力。英伟达最初于 2025 年 1 月发布了 Cosmos 模型系列,并于同年 8 月推出了更多扩展版本。

英伟达在一篇博客文章中指出,Alpamayo-R1 这类技术对于致力于实现 L4 级自动驾驶的企业至关重要。L4 级自动驾驶指在特定区域和限定条件下实现完全自动驾驶。

英伟达希望,此类具备推理能力的模型能赋予自动驾驶车辆类似人类的“常识”,从而更妥善地应对复杂的驾驶场景中的细微决策。

目前,该新模型已在 GitHub 和 Hugging Face 平台开源发布。

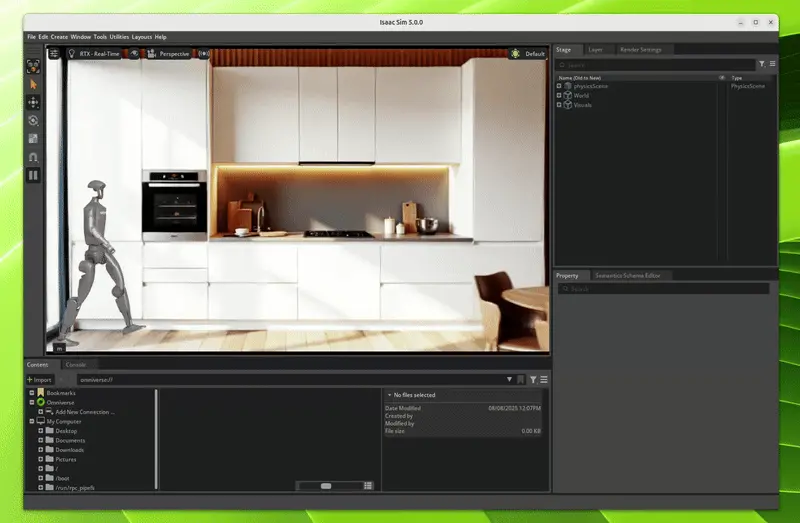

除发布新视觉模型外,英伟达还同步在 GitHub 上推出了名为“Cosmos Cookbook”的全套开发资源包,包含分步指南、推理工具及训练后工作流,以帮助开发者针对自身应用场景更高效地使用和训练 Cosmos 系列模型。该资源包涵盖数据整理、合成数据生成以及模型评估等关键环节。

上述发布正值英伟达全力进军具身智能领域,将其视为其先进 AI GPU 技术的新增长方向。

IT之家注意到,英伟达联合创始人兼首席执行官黄仁勋多次表示,人工智能的下一波浪潮将是具身智能。今年夏天,英伟达首席科学家比尔・达利(Bill Dally)在接受 TechCrunch 采访时也表达了相同观点,并特别强调了具身智能在机器人领域的应用前景。

“我认为,机器人最终将成为全球的重要角色,而我们的目标就是打造所有机器人的‘大脑’,”达利当时表示,“要实现这一目标,我们必须从现在开始研发关键技术。”

【来源:IT之家】