5 月 15 日消息,科技媒体 marktechpost 昨日(5 月 14 日)发布博文,报道称 Meta AI 旗下 FAIR 团队携手佐治亚理工学院,合作开发 CATransformers 框架,将碳排放作为核心设计考量,通过联合优化模型架构与硬件性能,显著降低总碳足迹,为可持续 AI 发展迈出重要一步。

机器学习技术的普及推动了从推荐系统到自动驾驶的革新,但其环境代价不容小觑。这些系统需要强大计算资源,常依赖定制硬件加速器运行,训练和推理阶段的高能耗直接导致运营碳排放攀升。

此外,硬件从制造到报废的全生命周期也产生“隐含碳”,加剧生态负担。随着全球各行业加速采用 AI 技术,解决运营与隐含碳的双重来源成为迫切需求。

当前减排方法主要集中于提升运营效率,例如优化训练和推理的能耗,或提高硬件利用率。但这些方法往往忽略硬件设计和制造阶段的碳排放,未能整合模型设计与硬件效率的相互影响。

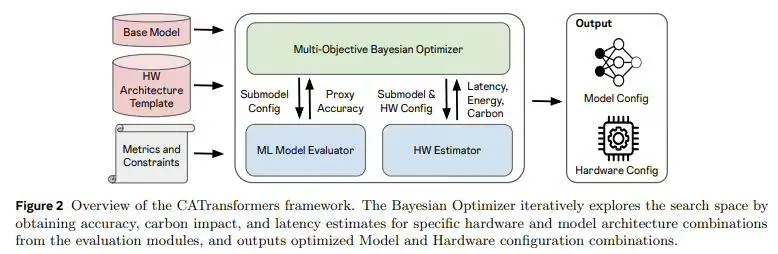

Meta 的 FAIR 团队与佐治亚理工学院联合推出的 CATransformers 框架,将碳排放纳入核心设计考量。该框架通过多目标贝叶斯优化引擎,联合评估模型架构与硬件加速器的性能,平衡延迟、能耗、精度和总碳足迹。

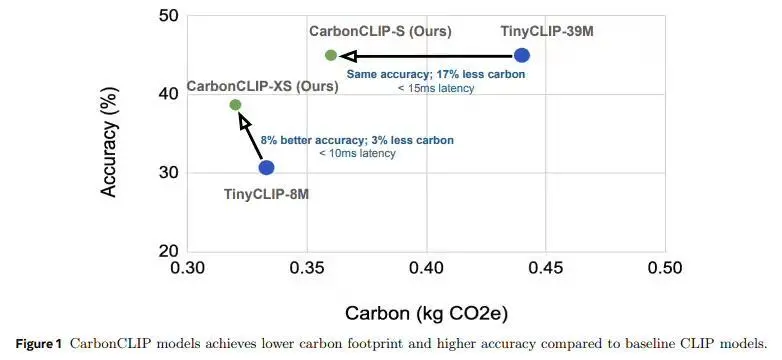

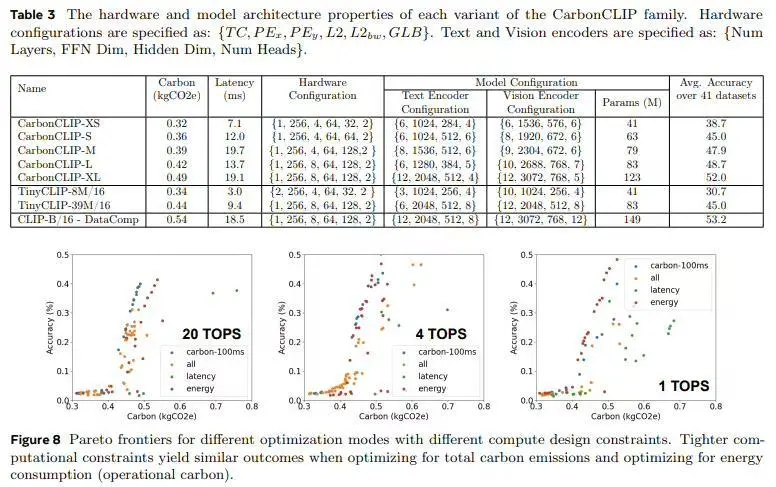

特别针对边缘推理设备,CATransformers 通过剪枝大型 CLIP 模型生成变体,并结合硬件估算工具分析碳排放与性能。其成果 CarbonCLIP-S 与 TinyCLIP-39M 精度相当,但碳排放降低 17%,延迟控制在 15 毫秒内;CarbonCLIP-XS 则比 TinyCLIP-8M 精度提升 8%,碳排放减少 3%,延迟低于 10 毫秒。

研究显示,单纯优化延迟的设计可能导致隐含碳增加高达 2.4 倍,而综合优化碳排放与延迟的策略可实现 19-20% 的总排放削减,且延迟损失极小。

CATransformers 通过嵌入环境指标,为可持续机器学习系统设计奠定基础。这表明,AI 开发若从一开始就结合硬件能力与碳影响考量,可实现性能与可持续性的双赢。随着 AI 规模持续扩大,该框架为行业提供了切实可行的减排路径。

【来源:IT之家】