3月19日,小米发布面向Agent时代的全模态基座模型Xiaomi MiMo-V2-Omni。该模型从底层构建融合文本、视觉、语音的全模态架构,将感知与行动深度绑定,原生支持多模态感知、工具调用、函数执行及GUI操作能力。

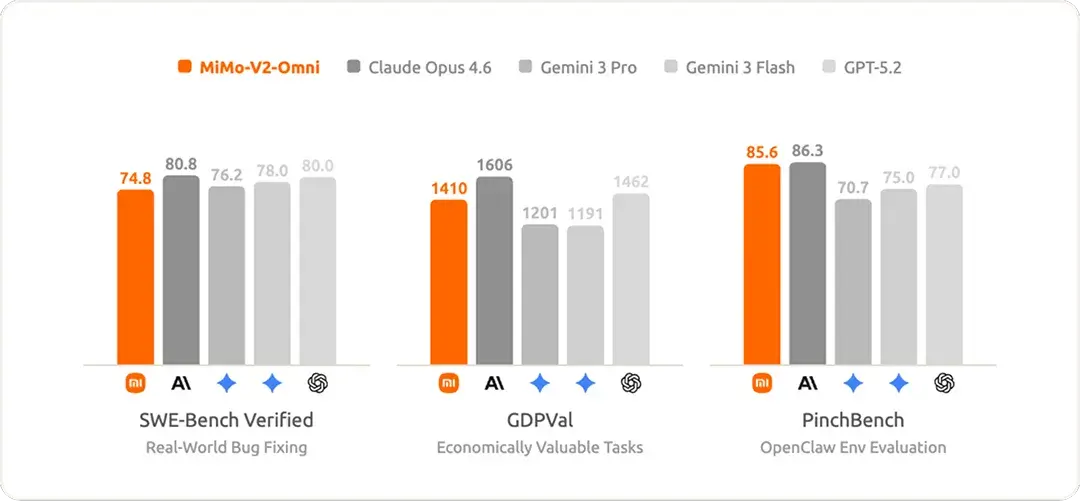

在正式发布前,小米将一个早期测试版本以“Healer Alpha”为代号匿名上架OpenRouter。上线期间调用量持续攀升,在OpenClaw测评榜单PinchBench上取得均分第一。

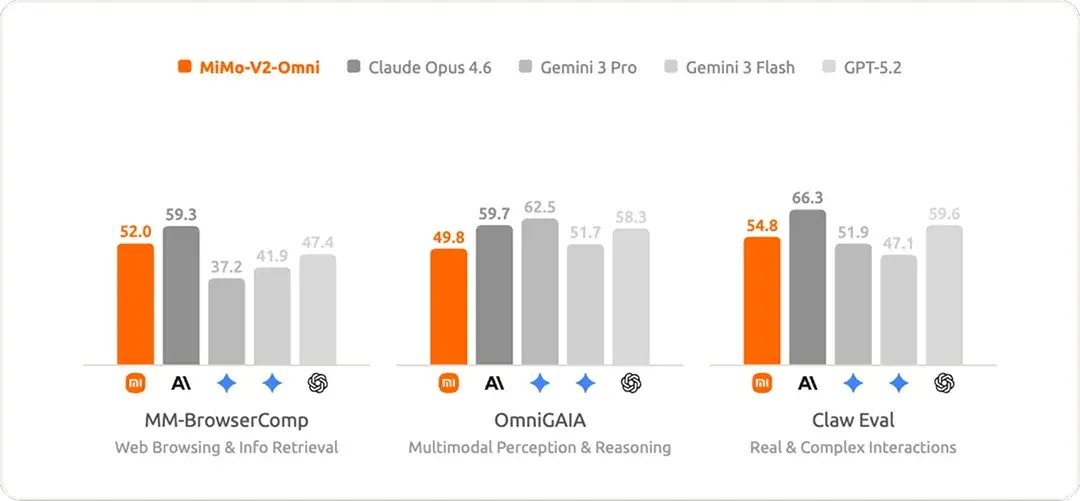

据官方介绍,MiMo-V2-Omni在音频理解方面支持环境声分类、多说话人分离、音频-视觉联合推理及超10小时长音频理解,综合表现超越Gemini 3 Pro。图像理解方面,在多学科视觉推理与复杂图表分析任务中超越Claude Opus 4.6,逼近Gemini 3 Pro等闭源模型水平。视频理解方面支持原生音视频联合输入,具备情境感知与未来推理能力。

智能体能力方面,该模型可在与真实数字环境交互的评测基准上比肩Gemini 3 Pro。在Browser Use场景中,结合OpenClaw框架可实现浏览器操控,完成信息检索、比价、与客服交互及下单等任务。与金山办公合作,接入WPS Office后,模型可根据指令生成Word文档、结构化Excel、排版规范的PDF及PPT。

MiMo-V2-Omni已开放API服务,支持256K上下文长度,输入0.4元/百万tokens,输出2元/百万tokens。小米联合OpenClaw、OpenCode、KiloCode、Blackbox及Cline等五大Agent开发框架团队,为全球开发者提供为期一周的限时免费接口支持。

【来源:凤凰网科技】